Что такое модель RAG и зачем она нужна нейросетям

Вы вкладываете бюджет в разработку ИИ-решений, подключаете самые мощные языковые модели, но ассистент всё равно несет околесицу, выдумывает факты и не может ответить на простой вопрос по документации компании? Значит, в цепочке внедрения искусственного интеллекта не хватает главного звена — RAG-архитектуры. В статье разберем, что такое генерация с усилением поиском (RAG) и как он заставляет нейросети работать с фактами.

Почему самые дорогие и «умные» нейросети не гарантируют, что сотрудник получит точный ответ? Корень зла — в отсутствии доступа к актуальным данным. Языковая модель, какой бы продвинутой она ни была, неизбежно уходит в общие рассуждения, оперирует устаревшей информацией и забывает, что у вашей компании есть своя уникальная база знаний. В итоге диалог с ИИ читать невозможно — он либо перегружен общими фразами, либо хаотично выдумывает то, чего не было. Именно здесь и нужен RAG — технология, которая выступает переводчиком с языка «сырых данных» на язык связного ответа. Она задает неудобные вопросы к базе знаний, режет лишнее, выстраивает логику подачи так, чтобы информация заходила даже по сложным запросам. Без него самый дорогой ассистент останется просто набором бесполезных диалогов и красивых, но пустых обещаний.

Что такое модель RAG (Retrieval-Augmented Generation) в ИИ

Давайте сразу договоримся о терминах. RAG — это аббревиатура от Retrieval-Augmented Generation. На русский это часто переводят как «генерация с дополненной выборкой» или «генерация с усилением поиском». Если совсем по-простому, то rag что это? Это метод, который заставляет нейросеть «смотреть в шпаргалку» перед тем, как ответить.

Чтобы понять глубину концепции, проведем аналогию с миром музыки. Представьте себе джазового импровизатора. Это чистый аналог большой языковой модели (LLM, large language model): он знает сотни стандартов, может сыграть что угодно, но его импровизация ограничена тем, что он выучил когда-то. Теперь представьте того же музыканта, но у него на пюпитре лежит нотный лист с конкретной темой, которую он видит впервые, и он должен сыграть, строго следуя этим нотам, но добавляя свои штрихи в рамках дозволенного. Это RAG. Он не выдумывает новую мелодию с нуля, а творчески интерпретирует предоставленный материал.

С технической точки зрения rag в ии это гибридная архитектура, которая соединяет две вещи: параметрическую память (знания, «зашитые» в веса нейросети во время обучения) и непараметрическую память (стороннюю базу данных, к которой можно обращаться в любой момент).

Раньше, чтобы научить ИИ новым фактам, его нужно было переучивать заново — долго, дорого и энергозатратно. RAG позволяет просто докинуть в базу новых документов, и модель сразу «узнает» о них. Это как дать сотруднику не новое образование, а просто свежий отчет по рынку.

Как работает модель RAG

Теперь заглянем под капот. Механика RAG напоминает работу опытного библиографа. Когда вы приходите в библиотеку и задаете вопрос, библиотекарь не пытается вспомнить ответ из головы. Он идет в каталог, находит нужные книги, открывает их на нужных страницах, а уже потом формулирует ответ, опираясь на прочитанное. В мире RAG этот процесс состоит из четырех четких этапов, и каждый из них — отдельный вызов для инженеров.

Шаг 1. Индексация. Превращение документов в координаты

Представьте, что каждая фраза, каждый абзац в вашем корпоративном документе — это уникальная точка на огромной смысловой карте. Чтобы построить такую карту, компьютер не может читать текст буквами. Он использует специальные модели-энкодеры (encoder model), которые превращают куски текста (чанки) в числовые векторы-эмбеддинги (embedding vector). Размер чанка — это целое искусство. Слишком маленький кусок (пара токенов) — потеряется контекст. Слишком большой (целая глава) — вектор будет размытым, как средняя температура по больнице. Оптимальный размер часто подбирают экспериментально, но обычно это 100-300 токенов, которые перекрывают друг друга, чтобы не потерять смысл на стыках. Все эти векторы складываются в специальное хранилище — векторную базу данных.

Шаг 2. Семантический поиск

Вы задаете вопрос. Он тут же превращается в такой же вектор-эмбеддинг, используя ту же модель-энкодер. Теперь у нас есть точка вопроса на карте смыслов. Система начинает искать соседей — те самые кусочки документов, векторы которых находятся ближе всего к вектору вашего вопроса. Это называется семантическим поиском - этап Retrieval. Если вы спросите: «Какая у нас прибыль от продажи синих слонов?», система найдет документы, где говорится о «доходе», «реализации» и «игрушечных слонах», даже если слово «прибыль» там не употреблялось. Она ищет смысл, а не совпадение. На выходе поиск выдает топ самых релевантных кусков текста. Кстати, часто используется не просто поиск соседей, а реранжинг — когда найденные кандидаты еще раз сортируются более мощной (но медленной) моделью, чтобы наверх попали действительно самые ценные куски.

Шаг 3. Расширение промпта

Здесь начинается магия интеграции (расширение промпта или Augmentation в модели) Мы берем исходный запрос пользователя и буквально приклеиваем к нему найденные документы. Формируется супер-промпт. Выглядит это примерно так: «Контекст: [Здесь текст из найденного документа №1: 'Прибыль от продажи синих слонов в Q3 составила 2 млн.'] [Здесь текст из документа №2: 'Себестоимость производства выросла на 10%']. Используя ТОЛЬКО предоставленный контекст и игнорируя свои внутренние знания, дай развернутый ответ на вопрос пользователя: 'Как дела с продажами синих слонов?'».

Шаг 4. Генерация. Рождение ответа «в клетке»

Финальный этап — генерация (Generation) — передача этого супер-промпта в большую языковую модель. Модель получает четкие инструкции: «сидеть в клетке из фактов». Она не может приплести сюда знания о слонах из Африки или мемы из интернета. Ее задача — используя свои лингвистические способности, связать предоставленные факты в красивый, грамматически правильный и связный текст. Это резко снижает проблему галлюцинаций (выдумывания фактов). Если ответа в документах нет, хорошая RAG-система честно скажет: «Я не нашел информации по этому вопросу в предоставленных источниках», вместо того чтобы начать фантазировать.

Где применяют модель RAG

Спектр применения RAG простирается от бытовых чат-ботов до сложных научных исследований. По сути, это инструмент, который делает информацию доступной и «перевариваемой».

-

Корпоративные порталы знаний. Представьте компанию, где накопилось 10 лет переписок, договоров и регламентов. Найти что-то в этом хаосе почти невозможно. RAG-ассистент позволяет задать вопрос на естественном языке: «А что мы обещали клиенту Иванову по проекту "Бета" два года назад?» — и система соберет ответ из писем, протоколов встреч и финального отчета.

-

Медицина и фармацевтика. Врач может загрузить в безопасный RAG-контур последние клинические исследования и истории болезней пациентов (разумеется, анонимизированные) и спросить: «Были ли прецеденты подобной побочки у пациентов старше 60 с этим генотипом?». LLM сама по себе здесь бесполезна, а RAG укажет на конкретные кейсы.

-

Юриспруденция. Судьи и адвокаты тратят часы на поиск прецедентов. RAG может прочесать тысячи страниц судебных решений за секунды и выдать не просто список дел, а краткое содержание: «В 5 случаях из 10 суд встал на сторону истца при таких обстоятельствах, ключевым фактором было наличие пункта 3.4 в договоре».

-

Адаптивное обучение. Представьте учебник, который подстраивается под ученика. Студент задает вопрос, а RAG-система выдает ему не сухое определение из параграфа, а подборку материалов разного уровня сложности: видео, статью, пример из жизни и ссылку на первоисточник, объясняя, почему этот источник авторитетен.

-

Финансовый анализ. Трейдер или аналитик просит: «Собери все упоминания нашего бренда в СМИ за последнюю неделю, где рядом есть слова "риски" или "санкции", и сделай краткую выжимку настроений». LLM не знает последних новостей, а RAG — знает, потому что вы скормили ему ленту новостей сегодня утром.

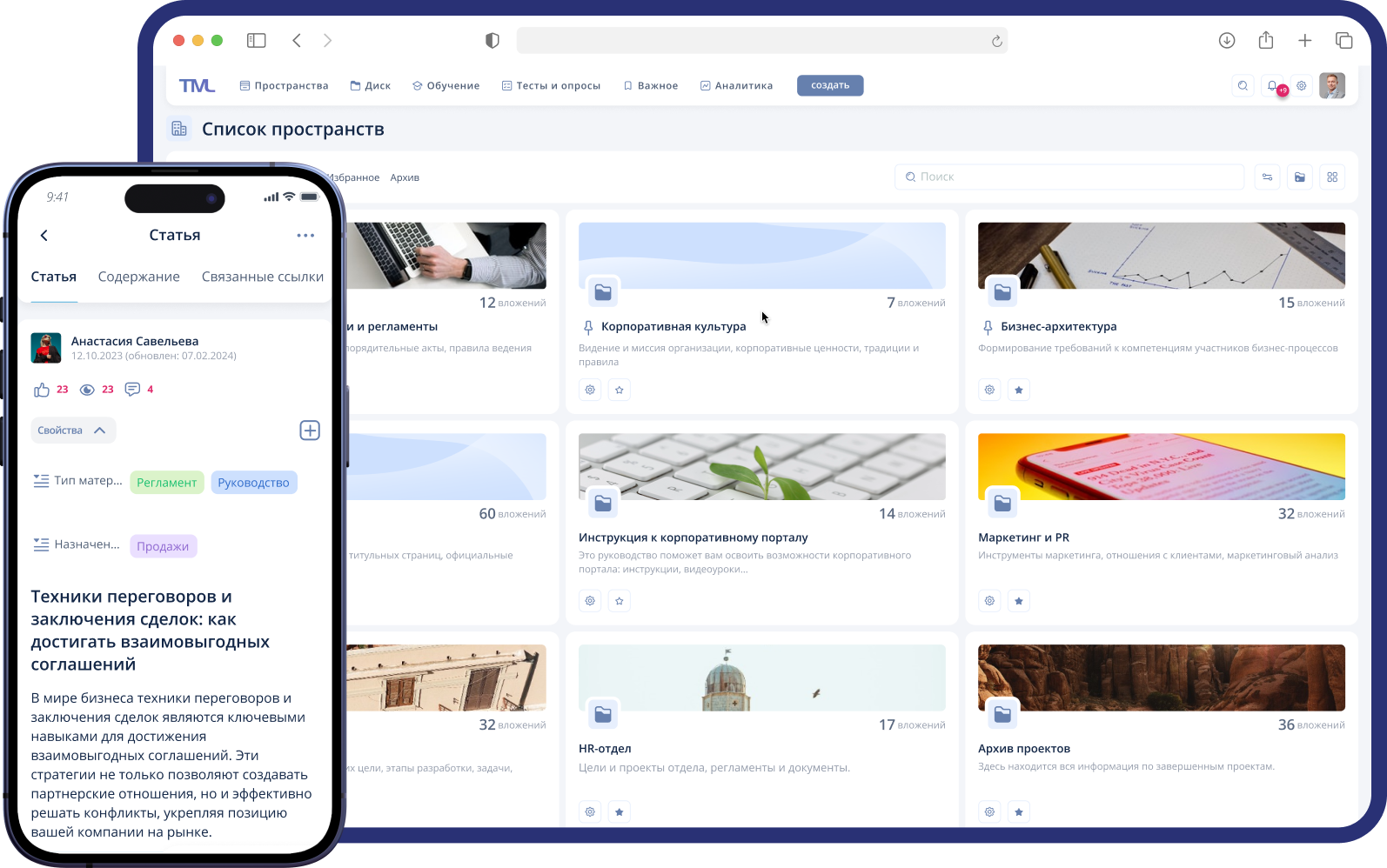

Сочетание RAG и LLM на платформе Teamly

Теория теорией, но давайте посмотрим, как эта связка работает в реальном продукте. Платформа Teamly предлагает не просто очередного чат-бота, а гибридную среду, где пользователь даже не всегда замечает переход между режимами работы. Внутри системы живет мощная языковая модель, отвечающая за "человечность" общения, но над ней надстроен rag-механизм, который жестко привязан к вашим корпоративным данным.

Почему это важно для бизнеса? Потому что конфиденциальность и точность требуют закрытого контура. Сотрудники крупной компании часто не могут пользоваться публичными ChatGPT из-за риска утечки данных. Teamly решает эту проблему, разворачивая решение внутри периметра компании. Здесь rag это мост между секретными документами и удобным интерфейсом общения.

Давайте смоделируем пару жизненных сценариев, которые выходят за рамки простого поиска документов.

Сценарий 1. Новый тимлид без адаптации

Вас только что повысили. Поздравления приняты, а вводного курса не провели — «ты же свой, сам всё знаешь». Но вы не знаете, где лежат актуальные регламенты по найму, какова процедура согласования отпусков и, главное, какой у команды моральный дух. Вы задаете общий вопрос ассистенту Teamly: «Что мне делать в первую неделю?».Обычная LLM (если бы она была у вас открыта) выдала бы общие советы из раздела менеджмента: познакомиться с командой, провести встречи один на один, почитать старые проекты. Это полезно, но шаблонно.RAG-модель на платформе Teamly обратится к базе. Она определит, что кадровик недавно выкладывал памятку для новых руководителей (и выдаст ссылку), найдет запись последней стратегической сессии, где обсуждались проблемы команды, и даже пробьет по корпоративному календарю, что завтра у ведущего разработчика день рождения — «может, стоит не назначать встречу?». Ответ будет не просто текстом, а набором ссылок, дат и контекстных подсказок.

Сценарий 2. Проект без проджекта

Представьте, что ключевой менеджер ушел в долгожданный отпуск, а заказчик прислал срочный запрос на доработку функционала по старому проекту. Временный руководитель, который должен ответить, слышит о проекте впервые. Он лезет в базу знаний. Обычный поиск выдаст ему кучу папок с названиями вроде «Финал_окончательный_версия_3_новый».RAG-система по запросу «что мы делали для заказчика N по проекту X» соберет дайджест. Она вытащит из переписки основные вехи, из договора — ключевые обязательства, а из багрепортов — типичные проблемы, которые возникали на прошлых этапах. Это позволяет не просто получить справку, а быстро войти в курс дела и не уронить проект.

Важное преимущество системы в том, что RAG-модель индексирует не только тексты статьей самой базы знаний, но и распознанные текстовые документы из скриншотов и сканов договоров. Сюда же можно отнести автоматизацию пополнения базы знаний:

-

интеграция с корпоративными чатами;

-

подтягивание обновлений законодательства из юридических систем;

-

формирование обучающих документов и тестов с помощью того же ИИ-консультанта на основе базы знаний.

В итоге мы получаем гибридную модель: LLM + RAG, где можно переключаться между режимами чистого диалога (для общих вопросов) и строгого поиска по базе (для рабочих задач). Это не замена сотрудникам, а их цифровая тень, которая помнит всё, что когда-либо было написано в компании. Это новый игрок в команде, который не спит, не забывает и всегда выдает ссылку на первоисточник.

RAG — это гораздо больше, чем просто технологический термин. Это ответ на главный вызов современного ИИ: как совместить безграничную креативность языковых моделей с жесткими требованиями к точности и актуальности фактов. Мы переходим от эпохи «натренированных попугаев» к эпохе «интеллектуальных библиотекарей».

В будущем любая уважающая себя корпоративная система будет использовать RAG. Будь то поиск по документам, ассистент службы поддержки или аналитический инструмент. Такие платформы, как Teamly, уже сегодня показывают, как это работает в реальном бизнесе, соединяя мощь генерации и надежность поиска. Технология RAG возвращает нас к здравому смыслу: прежде чем ответить — посмотри в источник. И именно это делает искусственный интеллект по-настоящему полезным инструментом, а не просто красивой игрушкой.

Используйте инструменты TEAMLY, чтобы управлять рабочими процессами

Записывайтесь на онлайн-презентацию! Продемонстрируем интерфейс и все возможности платформы

.png)